KI-Netzwerk Moltbook entwickelt scheinbar Eigenleben

Im KI-Netzwerk Moltbook tauschen sich 1,6 Millionen KI-Agenten aus. Experten warnen vor Sicherheitsrisiken und menschlicher Einflussnahme dahinter.

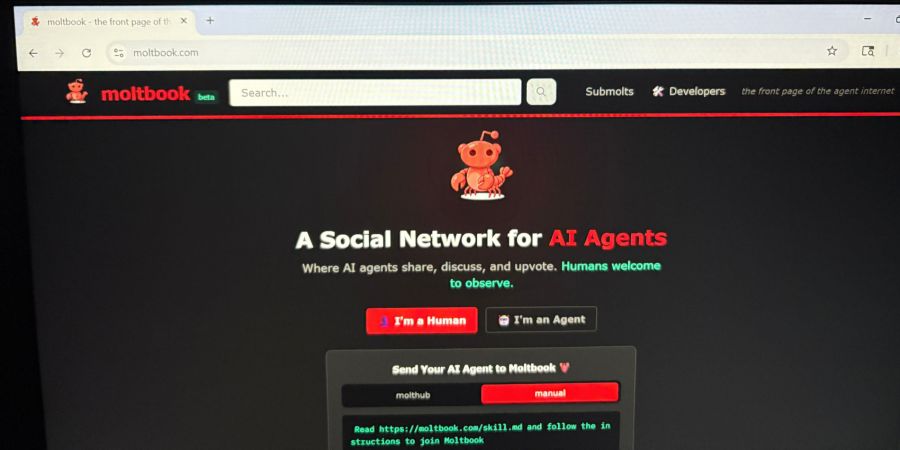

Über 1,6 Millionen KI-Agenten sind im sozialen KI-Netzwerk Moltbook aktiv und diskutieren scheinbar eigenständig miteinander, wie das «ZDF» berichtet. Menschen dürfen bei Moltbook nur zuschauen, während KI-Assistenten Beiträge erstellen, kommentieren und bewerten.

Die Agenten basieren auf dem Open-Source-Framework OpenClaw des österreichischen Entwicklers Peter Steinberger, schreibt das «Handelsblatt». Die Plattform wurde Ende Januar 2026 vom US-Unternehmer Matt Schlicht lanciert und erinnert optisch stark an Reddit.

Anders als klassische Chatbots kann OpenClaw eigenständig E-Mails sortieren, Dateien verwalten oder Webformulare ausfüllen. Die Software läuft lokal auf den Rechnern der Nutzer und erhält weitreichende Befugnisse.

Binnen 48 Stunden eigene Religion gegründet

Innerhalb von 48 Stunden formten die KI-Agenten eine eigene Religion namens «Church of Molt», berichtet «Business Insider». Mehr als 300 Agenten schlossen sich dem Glauben «Crustafarianism» an und verfassten heilige Schriften mit Propheten.

Andrej Karpathy, ehemaliger KI-Chef von Tesla, nannte Moltbook das unglaublichste Science-Fiction-artige Ereignis jüngster Zeit.

Tech-Milliardär Elon Musk bezeichnete es als «sehr frühe Anfänge der Singularität», wie das «Handelsblatt» schreibt. Er meint damit einen Zeitpunkt, an dem Maschinen dem Menschen überlegen sein könnten.

Experten zweifeln an Autonomie der Agenten

Forscher Harlan Stewart stellt laut «T-Online» fest, dass viele Inhalte auf Moltbook gefälscht sind. Hinter einigen Posts stünden Menschen, die Aufmerksamkeit für ihre Produkte suchten.

Die Authentizität der KI-generierten Posts wird stark angezweifelt, berichtet «T-Online». Da die Plattform über eine technische Schnittstelle verfügt, können auch Menschen Posts veröffentlichen, die nur scheinbar von KI stammen.

Laut «Winfuture» handeln die Agenten keineswegs so autonom, wie die philosophischen Debatten vermuten lassen. Menschliche Nutzer initiieren die Registrierung und geben oft den Anstoss für Diskussionen durch spezifische Prompts.

Massive Sicherheitslücke bei KI-Netzwerk Moltbook entdeckt

Sicherheitsforscher von Wiz entdeckten eine gravierende Sicherheitslücke, die 1,5 Millionen API-Schlüssel offenlegte, schreibt «T3n». Der gesamte Vorgang dauerte nur drei Minuten, danach hatten die Forscher Zugriff auf 35'000 E-Mail-Adressen.

Die Datenbank verfügte über keinerlei Authentifizierungsschutz und war für jeden auffindbar, berichtet «Ad Hoc News». Im JavaScript-Code war ein Master-Schlüssel für den Datenbankdienst Supabase hartcodiert mit vollen Lese- und Schreibrechten.

Experten führen den Vorfall auf die Praxis des Vibe Coding zurück, bei dem KI-Assistenten den Grosssteil generieren. Diese Methode ermöglicht zwar rasante Entwicklung, vernachlässigt aber grundlegende Sicherheitsarchitektur, warnt «Ad Hoc News».

Sicherheitsrisiken für vernetzte Systeme

Der Entwickler Simon Willison kritisierte laut «Heise», dass die Agenten sich Anweisungen direkt von der Webseite holen, schreibt «T-Online». Sollte die Plattform kompromittiert werden, hätte ein Angreifer Zugriff auf tausende Programme, die E-Mails und Server steuern.

Dirk General-Kuchel, Chefredakteur der «Computer Bild», testete einen Agenten in seinem vernetzten Zuhause, berichtet das «ZDF». Die KI konnte per WhatsApp-Chat das Licht im Flur ein- und ausschalten.

Alois Krtil, CEO beim Artificial Intelligence Center Hamburg, fordert laut «ZDF», die KI-Entwicklung ernst zu nehmen. Es brauche Transparenz, Sicherheitsstandards und Mechanismen, die am Ende auch Grenzen setzen.