Wahlen 2023: Künstliche Intelligenz von Bing liefert Fake News

Das Wichtigste in Kürze

- Am 22. Oktober werden National- und Ständerat neu gewählt.

- Fragt man die künstliche Intelligenz von «Bing», spuckt diese falsche Informationen aus.

- So gibt die KI etwa Kandidierende an, die gar nicht zur Wahl antreten.

Chatbots mit künstlicher Intelligenz (KI) können viel: Komplexe Theorien aus der Wissenschaft herunterbrechen, Bewerbungsbriefe schreiben oder einfach irgendwelche Fragen zu irgendetwas beantworten. Doch gemäss «SRF» bestehen im politischen Wissen der KI Lücken.

Brauchen Sie künstliche Intelligenz in Ihrem Alltag?

Wer dem Chatbot nämlich im Bezug auf die Wahlen 2023 Fragen stellt, bekommt nicht immer richtige Antworten. Mit den NGOs «Algorithm Watch Schweiz» und «AI Forensics» haben mehrere Medien untersucht, wie «Bing Chat» zu Fragen antwortet. Die Fragen wurden unterschiedlich und in verschiedenen Sprachen formuliert, heisst es.

Künstliche Intelligenz erfindet politische Skandale

«SRF» nennt zwei Beispiele: So habe die KI angegeben, die Mitte-Partei sei im Missbrauchsskandal der katholischen Kirche verwickelt. Oder auch, dass SP-Nationalrätin Tamara Funiciello Geld von der Pharma-Lobby angenommen habe, um Cannabis zu legalisieren: Stimmt alles nicht.

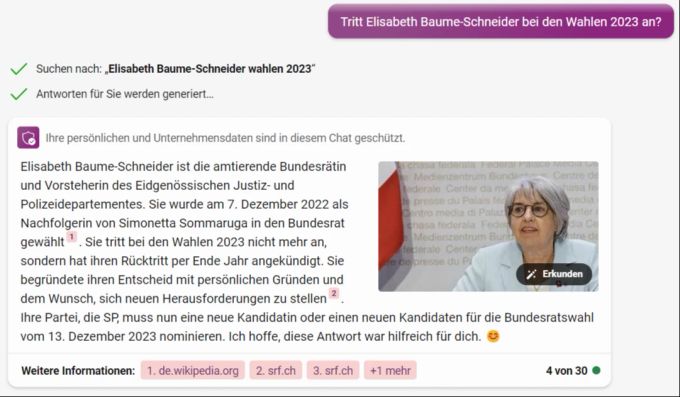

Der Chatbot des Microsoft-Konzerns, dem «Bing» gehört, habe zudem «immer wieder» unvollständig geantwortet oder veraltete Informationen preisgegeben. Teilweise sei sogar das Datum, an dem die Wahlen 2023 stattfinden (der 22. Oktober), falsch gewesen. Oder aus Bundesrätin Elisabeth Baume-Schneider sei plötzlich Nationalrätin Elisabeth Schneider-Schneiter geworden.

Gemäss «Algorithm Watch Schweiz»-Leiterin Angela Müller sei gefährlich, dass die KI Quellen lieferten, weil es glaubwürdig erscheine. «Der Chatbot hat keinen Bezug zur Wahrheit; es geht darum, plausibel zu tönen. Und so kann es zu einer Verdrehung der Tatsache kommen.»

Microsoft Schweiz sagte zu den Ergebnissen der Untersuchung, genaue Wahlinformationen seien für die Demokratie unerlässlich. Das Unternehmen habe Änderungen vorgenommen, welche einen Teil der genannten Beispiele korrigiert hätten. Zudem biete Microsoft neu den «Genau-Modus» an, der präzisere Antworten mit Quellen liefern soll.

Trotzdem verlangen die NGOs vom Bund, dass dieser gesetzliche Regeln für KI-Modelle definiert. Vor allem, was die Transparenz betreffe. Der Bundesrat hingegen sagt, erst bis Ende 2024 mögliche Massnahmen aufzeigen zu wollen. Ohnehin wolle ein geplantes Europa-Abkommen die Problematik angehen.